Claude Code 近期最重大更新:background session

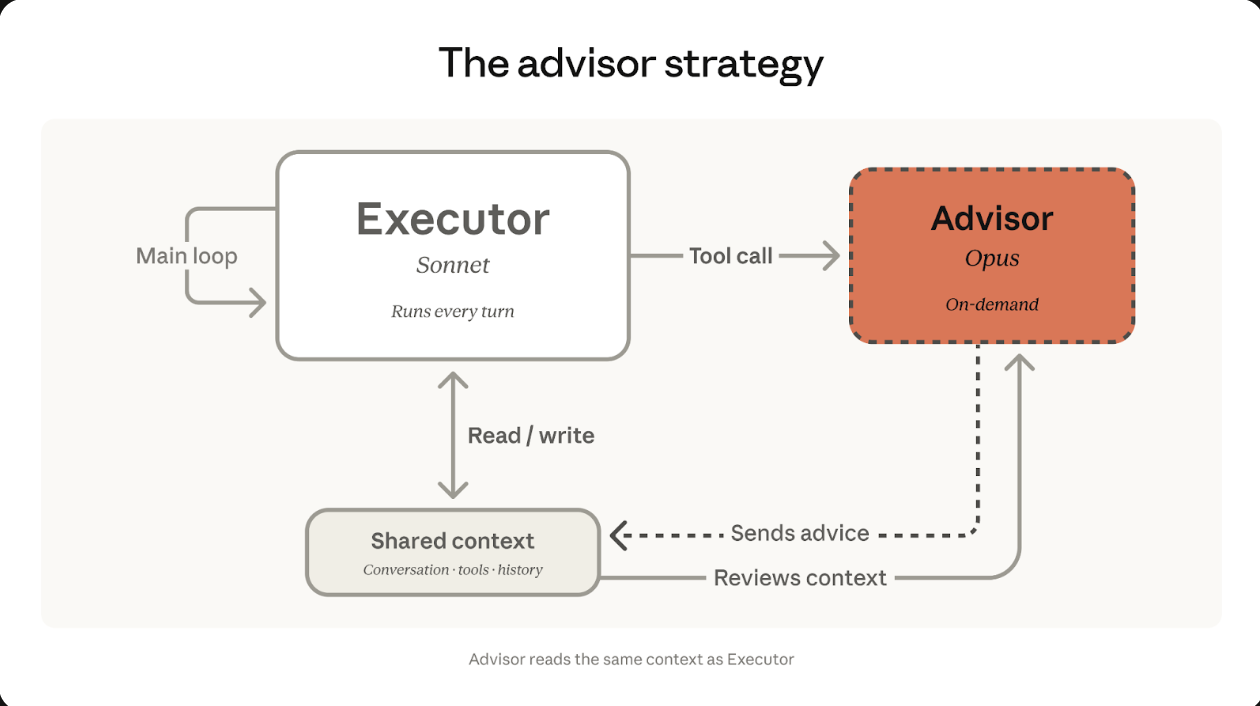

2026-05-11,Anthropic 在 v2.1.139 把背景 session 從實驗功能升級成第一公民。 在session 下 /bg 或 claude --bg 把任務推背景 空 prompt 按 ← 直接 detach。 如果你還把 Claude Code 當成「跑完一次就關掉」的 CLI,這次更新會徹底改你的工作流。 為什麼這次更新重要 之前 Claude Code 的互動模型是「跑一個任務 → 它跑完 → 我看結果」。 Background session + agent view 把模型換成「我同時跑 5 個 task、它們各自進展、我隨時 peek 任何一個」。 對跑很久的任務(整理一整個 codebase、跨多個檔案改寫、長時間查資料)這是革命——你不用守在終端機前等。對同時做很多專案的人這是必要——終於可以同時推進 3 個 repo 而互不干擾。 對 /loop 這類定時任務——終於有 native 容器跑它而不用魔改 launchd 或 cron。 更深一層:這是 Anthropic 對「agent 不是 chat sessio